Marco Antonio García Briones.

La cantidad de estudiantes que usan herramientas de inteligencia artificial (IA), como ChatGPT, para escribir sus artículos parece ser un problema mucho mayor de lo que se dice en público.

Las trampas en la educación superior están tan extendidas que, en países como Gran Bretaña y Estados Unidos, un gran número de estudiantes han sido expulsados por mala conducta académica, hasta el punto de que algunos cursos habían perdido la mayor parte del año de admisión. En México aún es escasa la estadística, pero cuando se está frente a grupo -por ejemplo, en educación superior- es posible externar una apreciación por lo menos empírica.

Detectar ensayos sospechosos de hecho puede ser fácil, porque cuando se pregunta a los estudiantes por qué incluyen ciertos términos o fuentes de datos que no se mencionan en los contenidos de sus materias, lo normal es queden desconcertados. Lo más común es que ni siquiera han escuchado algunos de los términos que aparecen en sus tareas, ensayos o investigaciones.

La detección de trampas es sólo la mitad de la batalla. Lograr que las autoridades de educación aborden el problema puede resultar complicado, especialmente cuando los tramposos son estudiantes que pagan colegiaturas o cuotas. Debido a que las universidades dependen en gran medida de esos ingresos, algunos directivos o administradores ven con malos ojos los esfuerzos por exponer el problema.

Aquí hay más en juego que la injusticia de que los tramposos obtengan ventaja sobre los estudiantes honestos. Consideremos la posibilidad de que graduados supuestamente expertos salgan al mundo y sean reclutados en organizaciones, ya sea en servicios de salud o sector energético, donde se les coloque en puestos para los que no están cualificados.

Entonces, ¿Qué tan extendido está el problema de las trampas?

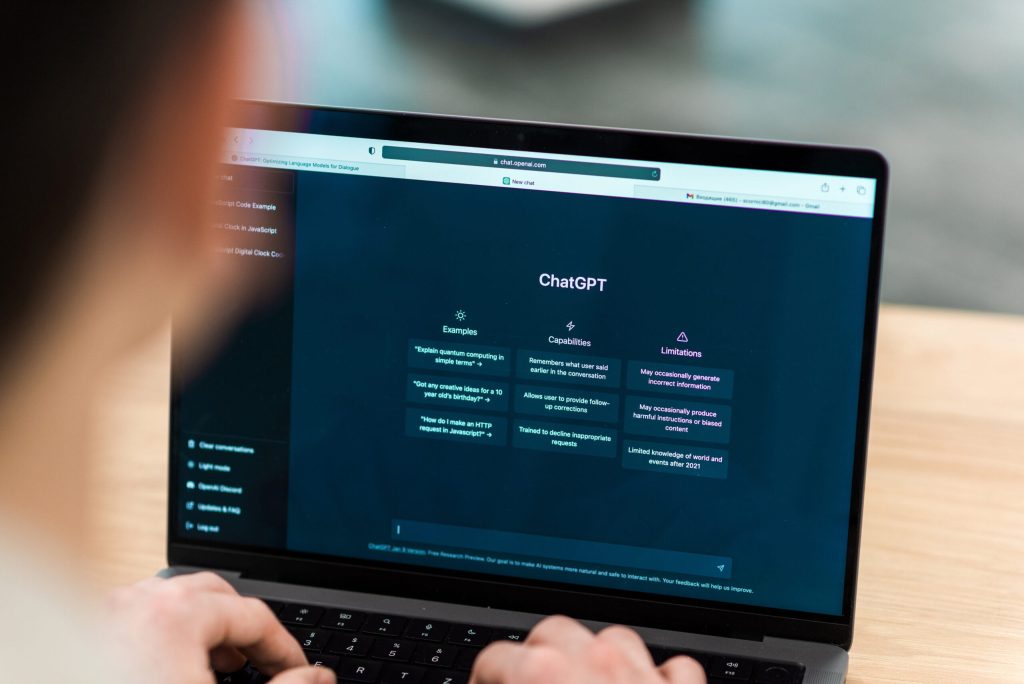

El pánico por la transformación de ChatGPT en los ámbitos educativos se disparó tan pronto como se lanzó la herramienta en noviembre de 2022 y, desde entonces, la tecnología no ha hecho más que avanzar. Mientras escribo estas palabras Open AI, que creó ChatGPT, y Meta están listos para lanzar modelos de IA mejorados capaces de razonar y planificar.

Pero el impacto exacto de la IA en las aulas no está claro. En Estados Unidos, investigadores de la Universidad de Stanford dijeron el año pasado que las tasas de trampa no parecían haberse visto afectadas por la IA. Hasta el 70 por ciento de los estudiantes de bachillerato han confesado durante mucho tiempo haber hecho alguna forma de trampa y casi un año después de la llegada de ChatGPT esa proporción no había cambiado.

En las universidades, las investigaciones muestran que la mitad de los estudiantes son usuarios habituales de IA generativa (no necesariamente para hacer trampa), pero sólo alrededor del 12 por ciento la utilizan a diario.

Cuando se trata del número de ensayos, de estudiantes, escritos con la ayuda de IA, las tasas parecen relativamente estables, dice Turnitin, un servicio de software de detección de plagio que tiene una herramienta para verificar el uso de IA generativa. Este servicio ha informado que los estudiantes han presentado más de 22 millones de artículos en los últimos 12 meses que muestran signos de ayuda de la IA, lo que representó el 11 por ciento del total que revisó. Más de 6 millones de artículos, o el 3 por ciento del total, contenían al menos el 80 por ciento de escritos de IA. Son muchos documentos. Pero el porcentaje de escritura de IA es prácticamente el mismo que encontró Turnitin cuando realizó una evaluación similar el año pasado.

Las tasas de uso de IA se han mantenido estables, afirma Chris Caren, director ejecutivo de Turnitin. “El hecho de que estés usando ChatGPT no significa necesariamente que estés haciendo trampa”. “Algunos profesores y académicos permiten cierto nivel de asistencia de IA al escribir un ensayo, pero también quieren que se cite adecuadamente”, dice. “La IA puede ser increíblemente útil para realizar investigaciones y generar ideas.

Estoy seguro de que esto es correcto. También es cierto que los profesores universitarios utilizan cada vez más la IA para ayudar a redactar planes de lecciones y conozco a algunos que la han probado para calificar ensayos, sin éxito.

Pero todavía me preocupa que muchos estudiantes estén usando herramientas como ChatGPT de una manera potencialmente riesgosa para los empleadores y la sociedad en general.

Algunas universidades ya están aumentando las evaluaciones presenciales para detectar y desalentar las trampas de la IA. Estoy seguro de que esto continuará, pero también sería útil que se aliente a los académicos a exponer el problema, en lugar de disuadirlos de intentar solucionarlo. El propósito de ir a la universidad es aprender a aprender. Se supone que debemos enseñar a pensar y evaluar la evidencia, no simplemente a recitar hechos y cifras.

Cualquiera que subcontrate su pensamiento a una máquina será, en última instancia, el que más daño sufrirá.